Bedienen we binnenkort onze tv’s, tablets en smartphones – maar bijvoorbeeld ook de multimediaconsole in onze auto – met handgebaren? Inton Tsang, senior research scientist bij IDLab (een imec-onderzoeksgroep aan UAntwerpen en de UGent) denkt van wel. Inton is gespecialiseerd in het onderzoek naar slimme radarsystemen, en ziet ‘gesture recognition’ (of gebarenherkenning) als een veelbelovende toepassing. We stelden hem vijf vragen over het potentieel ervan, en over de onderliggende technologische bouwblokken.

Hoe zal gebarenherkenning, of ‘gesture recognition’, de manier veranderen waarop we met technologie interageren?

Inton Tsang: Op het internet circuleren tal van grappige filmpjes met in de hoofdrol digitale assistenten die gesproken commando’s hopeloos verkeerd interpreteren. Het is exemplarisch voor de uitdagingen waarmee stemherkenningssoftware zich geconfronteerd ziet.

De vraag die ik en mijn collega’s proberen te beantwoorden, is dan ook: wat als slimme technologie menselijke lichaamstaal zou kunnen herkennen en interpreteren? Het zou de communicatie tussen mens en machine eenvoudiger en intuïtiever maken, en in heel wat domeinen – zoals gaming, virtuele en augmented reality, maar ook robotica – voor een revolutie kunnen zorgen.

Figuur-1: Dankzij gebarenherkenning zal je met eenvoudige handsignalen de multimediaconsole in je auto kunnen aansturen – van het aannemen of weigeren van een telefoongesprek, tot het instellen van navigatiebestemmingen. Bron: imec (testopstelling).

Uiteraard: om dat soort toepassingen te kunnen ontwikkelen, hebben we een aantal bouwstenen nodig – zoals sensoren en artificiële intelligentie. En ook radartechnologie lijkt een belangrijke rol te gaan spelen.

Waarom zou je opteren voor radartechnologie om aan gebarenherkenning te doen? Is het niet eenvoudiger om een videocamera te gebruiken?

Inton Tsang: De keuze voor een (video)camerasysteem om aan gebarenherkenning te doen, ligt voor de hand. Maar uiteindelijk willen we een oplossing ontwikkelen die efficiënt én in alle omstandigheden haar werk doet, en dan heeft radartechnologie een streepje voor.

Eigenlijk combineren radarsystemen het beste van twee werelden. Door de snelheid waarmee ze werken, zijn ze enerzijds in staat om de meest subtiele handgebaren te detecteren. En bovendien presteren ze ook bij een minder goede zichtbaarheid, zoals ‘s nachts, bij felle zon, regen, hagel en sneeuw. Wist je trouwens dat radarsensoren zelfs aan gebarenherkenning kunnen doen wanneer ze zich achter een glazen, plastic of papieren scherm bevinden? Ze kijken er moeiteloos dwars doorheen.

Daarnaast beschikt radartechnologie over een vorm van ‘dieptezicht’, waardoor irrelevante of drukke scènes op de achtergrond makkelijk kunnen worden weggefilterd. Als je dat bij een videobeeld wil doen, komt daar heel wat (extra) rekenkracht bij kijken.

En tenslotte is er nog het privacyvraagstuk: in tegenstelling tot een camera brengt een radarsysteem de gebruikers niet ‘in beeld’, waardoor hun privacy niet in het gedrang komt.

Radarsystemen hebben dus een aantal voordelen. Op welke vlakken schieten ze vooralsnog tekort?

Inton Tsang: Radartechnologie heeft het nadeel dat het aanbod aan commerciële systemen vooralsnog een stuk beperkter is. Maar dat is waarschijnlijk slechts een kwestie van tijd.

Een veelgehoorde kritiek is ook dat radarsystemen veel groter zouden zijn dan bijvoorbeeld videocamera’s – maar dat is niet per se juist. Onder meer door gebruik te maken van nanotechnologie en chipfabricageprocessen is de industrie erin geslaagd de afmetingen van radarsensoren aanzienlijk te reduceren.

Hoe past artificiële intelligentie in dit plaatje?

Inton Tsang: Een toepassing als gebarenherkenning staat of valt met de kracht van de onderliggende artificiële intelligentie (AI). Die moet snel, accuraat én op een energiezuinige manier data interpreteren, maar dat is verre van evident.

Het ontwikkelen en verfijnen van een AI-chip die aan die specifieke eisen voldoet, past dan ook volledig binnen de onderzoeksactiviteiten van imec. Met resultaat, trouwens: in 2020 stelden imec-onderzoekers ’s werelds eerste chip voor die radarsignalen verwerkt door gebruik te maken van een zogenaamd ‘spiking recurrent neuraal netwerk’ dat de manier nabootst waarop neuronen werken. Daardoor verbruikt de chip tot 100 keer minder energie dan eerdere oplossingen, en ligt zijn reactiesnelheid 10 maal hoger.

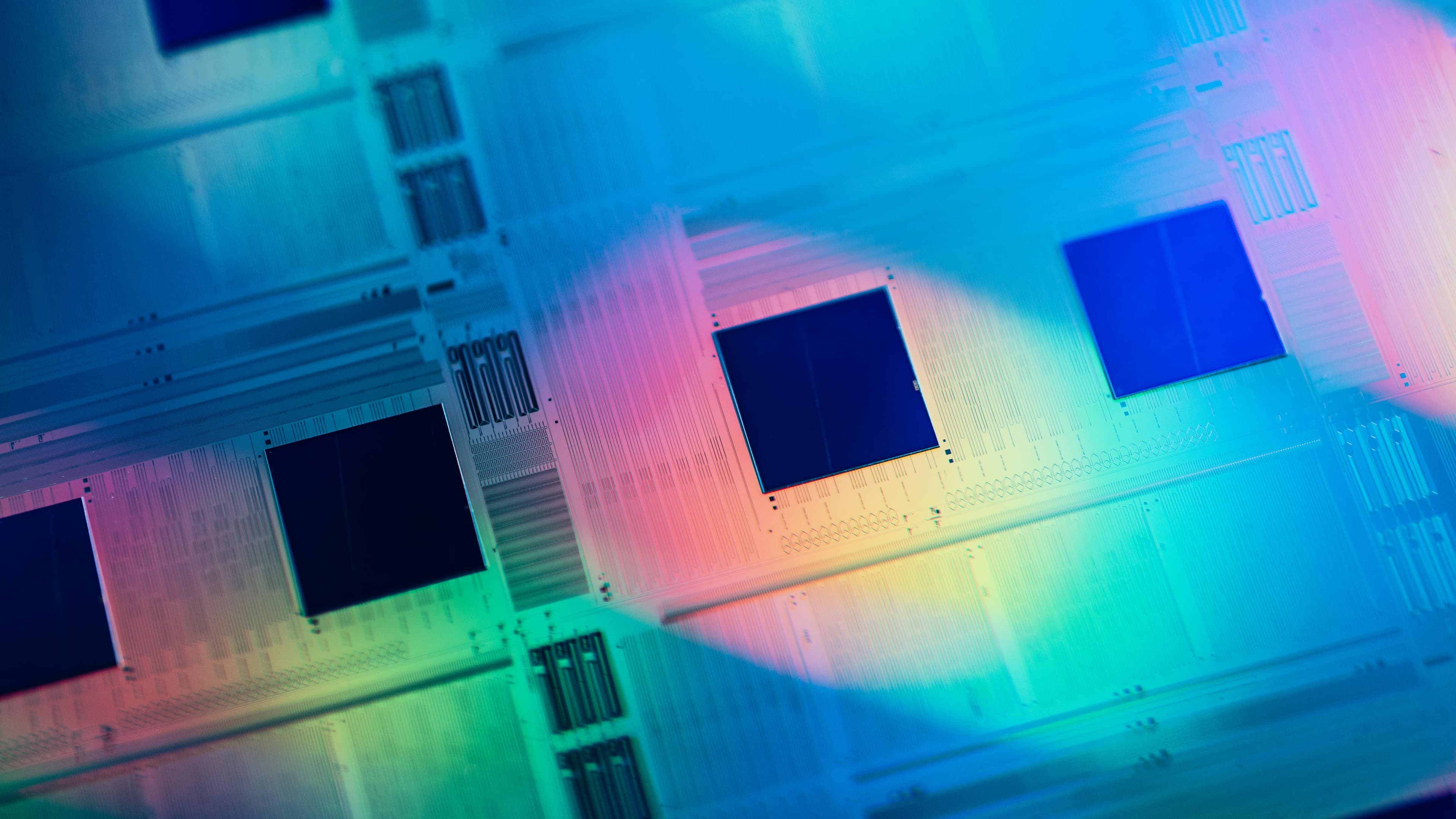

Figuur-2: ’s Werelds eerste chip die radarsignalen verwerkt door gebruik te maken van een zogenaamd ‘spiking recurrent neuraal netwerk’ dat de manier nabootst waarop neuronen werken. Deze chip werd overigens ontwikkeld met steun van het Vlaams AI Onderzoeksprogramma (VAIOP). Bron: imec.

Om te testen hoe hoog de chip scoort op het vlak van gebarenherkenning, maakten mijn collega’s en ikzelf gebruik van de Soli-dataset van Google. Die vloeit voort uit de gelijknamige radarchip die speciaal door Google werd ontwikkeld om (hand)bewegingen nauwkeurig en in real time in kaart te brengen. De Soli-dataset geldt nog steeds als de absolute referentie op het gebied van gebarenherkenningssystemen – en was dan ook een dankbare bron van input om onze eigen prestaties mee te vergelijken. Met een nauwkeurigheid van meer dan 98%, gekoppeld aan een laag energieverbruik, bleken we uiteindelijk zelfs beter te scoren dan de Google-oplossing.

In welke concrete applicaties gaan we gebarenherkenningstechnologie de volgende jaren tegenkomen?

Inton Tsang: Eén heel concrete toepassing is het aansturen van de multimediaconsole in je wagen. Gedaan met aan een knop te draaien, of doorheen pagina’s op een touchscreen te scrollen. Dankzij gebarenherkenning zal je met eenvoudige handsignalen een telefoongesprek kunnen aannemen of weigeren, het audiovolume harder of zachter zetten, navigatiebestemmingen instellen, enz. Er zijn vandaag trouwens al autoconstructeurs die dit feature aanbieden – weliswaar niet met radartechnologie, maar wel door gebruik te maken van videocamera’s. Maar naarmate radartechnologie matuurder wordt, gaat die – zoals eerder gezegd – een steeds interessanter en performanter alternatief vormen voor de bestaande camerasystemen.

Ook bedrijven zoals Google zien volop brood in gebarenherkenning. Een mooi voorbeeld is de Nest Hub, die effectief gebruik maakt van de Soli-radarsensor. Daardoor kunnen gebruikers muzieknummers en video’s afspelen of pauzeren, maar ook alarmen uitzetten – met een simpel handgebaar.

En ook de manier waarop we interageren met computers zou er volgens Google in de toekomst wel eens helemaal anders kunnen uitzien: zo willen ze intelligente computersystemen creëren die met handgebaren of een hoofdknik worden aangestuurd.

Het mag dus duidelijk zijn: onderzoekers én commerciële bedrijven steken op het vlak van gebarenherkenning (letterlijk en figuurlijk) de handen uit de mouwen!

Dit artikel verscheen eerder als bijdrage op de website van Engineeringnet - https://engineeringnet.be/nl/nieuws/item/21585/slimme-geminiaturiseerde-radarsystemen-voor-gesture-recognition-toepassingen

Inton Tsang is senior AI-onderzoeker bij IDLab, een imec onderzoeksgroep aan UAntwerpen en de UGent. Hij werkt er aan neuromorfische systemen die op een intelligente manier sensordata verwerken, afkomstig van bijvoorbeeld radar en DVS, om zo autonome oplossingen mogelijk te maken. Eerder was hij aan de slag bij Nokia, waar hij focuste op projecten rond netwerkarchitectuur, machinelearningtechnieken en protocolontwikkeling.

Inton behaalde een doctoraat in natuurkunde aan de Universiteit Antwerpen, en een diploma elektrotechniek aan de Universidade Federal de Pernambuco (Brazilië).

Gepubliceerd op:

4 juli 2023